പ്രിയപ്പെട്ടവർ കടം ചോദിച്ചാൽ കൊടുക്കും മുൻപ് ഈ വാർത്തകൂടി അറിഞ്ഞ് വയ്ക്കൂ!

എന്തെങ്കിലും ഒരു അത്യാവശ്യം വന്നാൽ, നമ്മുടെ കൈയിൽ പണമില്ലെങ്കിൽ അടുത്ത സുഹൃത്തുക്കളോടോ ബന്ധുക്കളോടോ നാം കടം ചോദിക്കാറുണ്ട്. കൃത്യമായി തിരിച്ചു കിട്ടുമെന്ന് വിശ്വാസമുണ്ടെങ്കിൽ പലരും ഇങ്ങനെ പണം കൊടുക്കാറുണ്ട്. ചിലർ തിരിച്ചുകിട്ടില്ലെന്ന് അറിയാമായിരുന്നിട്ടും ചോദിക്കുന്ന ആളോടുള്ള സ്നേഹം കൊണ്ടും കടം കൊടുക്കാറുണ്ട്.

അത്യാവശ്യമായി വേണ്ട തുക ഇത്തരത്തിൽ കടമായി ലഭിക്കുന്നത് പലർക്കും വലിയ സഹായമായി മാറുന്നു. എന്നാൽ ഇത്തരം കടം വാങ്ങലുകൾക്ക് ഒരു വലിയ വെല്ലുവിളി ഇപ്പോൾ ടെക്നോളജി രംഗത്തുനിന്ന് ഉയർന്നുവന്നിരിക്കുന്നു. ലോകമെങ്ങും നല്ലതിനും ചീത്തയ്ക്കും ഉപയോഗപ്പെടുത്തിക്കൊണ്ടിരിക്കുന്ന ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് അഥവാ എഐ ആണ് ഈ വെല്ലുവിളിക്ക് പിന്നിലുമുള്ളത്.

നമ്മൾ സൃഹൃത്തുക്കളോട് കടം വാങ്ങുന്നത് നേരിട്ട് ചോദിച്ചിട്ട് ആയിരിക്കണമെന്നില്ല. ചിലപ്പോൾ കോൾ വഴിയോ അല്ലെങ്കിൽ വാട്സ്ആപ്പ് വഴിയോ മറ്റോ ആകാം. അത്തരത്തിൽ സുഹൃത്തുക്കളുടേത് എന്ന് പറഞ്ഞ് എത്തുന്ന കോളുകളും മെസേജുകളും ഇനിയുള്ള കാലത്ത് അത്ര വിശ്വസിക്കാൻ ആകില്ല എന്നതാണ് ഇപ്പോഴത്തെ പ്രശ്നം.

എഐയുടെ സഹായത്തോടെ ആളുകളുടെ ശബ്ദം അതേ വിധത്തിൽ അനുകരിക്കാൻ സാധിക്കും. ഇത്തരത്തിൽ എഐ ഉപയോഗിച്ച് ആളുകളുടെ ശബ്ദം അനുകരിച്ച് സുഹൃത്തുക്കളിൽ നിന്നും ബന്ധുക്കളിൽ നിന്നും പണം തട്ടുന്ന എഐ വോയിസ് സ്കാമുകൾ വർധിക്കുന്നു എന്ന് റിപ്പോർട്ടുകൾ സൂചിപ്പിക്കുന്നു. കഴിഞ്ഞ ദിവസം ഇത്തരത്തിൽ ഒരു തട്ടിപ്പ് നടക്കുകകയുണ്ടായി.

പഞ്ചാബ് സ്വദേശിനിയായ 59 വയസുകാരിയാണ് എഐ വോയിസ് തട്ടിപ്പിന് ഇരയായത്. കാനഡയിലുള്ള അനന്തിരവൻ പ്രഭ്ജോത് ആണ് വിളക്കുന്നത് എന്ന തരത്തിൽ ഈ സ്ത്രീക്ക് ഒരു ദിവസം രാത്രിയിൽ ഒരു കോൾ എത്തി. "അദ്ദേഹം എന്റെ മരുമകനെപ്പോലെയാണ്, ഞങ്ങൾ വീട്ടിൽ സംസാരിക്കുന്ന പഞ്ചാബി ഭാഷയിൽ എല്ലാ കൃത്യമായാണ് സംസാരിച്ചത്''.

''രാത്രി ഏറെ വൈകിയാണ് കോൾ എത്തിയത്. തനിക്ക് ഒരു അപകടമുണ്ടായി, ജയിലിൽ കിടക്കാൻ പോകുകയാണെന്നും പണം നൽകി സഹായിക്കണമെന്നും അഭ്യർഥിച്ചു. കൂടാതെ സംഭവം രഹസ്യമായിരിക്കണമെന്നും ആരോടും പറയരുതെന്നും നിർദേശിച്ചു'' എന്ന് തട്ടിപ്പിനിരയായ സ്ത്രീ സംഭവത്തെ വിവരിച്ചു. കോൾ വന്നതിനെ തുടർന്ന് അയാൾ ആവശ്യപ്പെട്ട തുക അവർ ഓൺലൈനായി നൽകിയിരുന്നു.

ഇതിന് ശേഷം കാനഡയിലുള്ള അനന്തിരവന്റെ യഥാർഥ കോൾ എത്തിയപ്പോഴാണ് തട്ടിപ്പിനിരയായത് അവർ തിരിച്ചറിയുന്നത്. അപ്പോഴേക്കും പണം നഷ്ടമായിരുന്നു. യാതൊരു സംശയത്തിനും ഇട നൽകാത്ത വിധത്തിൽ കൃത്യമായ ആസൂത്രണത്തോടെയാണ് ഇവിടെ തട്ടിപ്പുകാർ പെരുമാറിയത്. ഒരു അടിയന്തര സാഹചര്യത്തിന്റെ കഥ സൃഷ്ടിക്കുകയും എഐ ഉപയോഗിച്ച് ബന്ധുവിന്റെ ശബ്ദം അനുകരിച്ച് പ്ലാൻ കൃത്യമായി നടപ്പാക്കുകയുമായിരുന്നു.

തട്ടിപ്പുകാർ സൃഷ്ടിക്കുന്ന 'അടിയന്തര സാഹചര്യ'ത്തിന്റെ അന്തരീക്ഷം നിലനിൽക്കുന്നതിനാൽ പലരും ഇത്തരത്തിൽ വരുന്ന കോളുകളുടെ ചെറിയ പോരായ്മകൾ ശ്രദ്ധിക്കാതെ പോകുന്നു. പരിചിതമായ ശബ്ദം മറുതലയ്ക്കൽ കേൾക്കുന്നതിനാൽ വിളിക്കുന്നത് യഥാർഥ ബന്ധുവോ സുഹൃത്തോ ആണെന്ന് ധരിച്ച് പലരും പണം നൽകുന്നു. ഇത്തരം തട്ടിപ്പുകൾ ഇതിനുമുൻപും റിപ്പോർട്ട് ചെയ്യപ്പെട്ടിട്ടുണ്ട്. ടെക്നോളജി വികസിക്കുന്നതോടെ ഈ തട്ടിപ്പും കൂടുതൽ പുരോഗമിക്കും.

ഇത്തരം തട്ടിപ്പുകളുടെ സങ്കീർണ്ണമായ രീതിയെപ്പറ്റി ഡൽഹിയിലെ സെന്റർ ഫോർ റിസർച്ച് ഓൺ സൈബർ ഇന്റലിജൻസ് ആൻഡ് ഡിജിറ്റൽ ഫോറൻസിക്സിലെ (സിആർസിഐഡിഎഫ്) ഓപ്പറേഷൻസ് ഡയറക്ടർ പ്രസാദ് പതിബന്ദ്ലയുടെ വിശദീകരണം ഇന്ത്യാടുഡേ റിപ്പോർട്ട് ചെയ്തിട്ടുണ്ട്. എഐ വോയ്സ് അനുകരണ ഉപകരണങ്ങൾക്ക് ഒരു വ്യക്തിയുടെ ശബ്ദം കൃത്യമായി അനുകരിക്കാനാകുമെന്ന് അദ്ദേഹം പറയുന്നു.

"സോഷ്യൽ മീഡിയയിൽനിന്നോ, സെയിൽസ് കോളുകൾ പോലുള്ള പൊതു ഡൊമെയ്നിൽ ലഭ്യമായ ഡാറ്റ ഉപയോഗിച്ചോ ആളുകളുടെ വോയിസ് കൈക്കലാക്കിയ ശേഷം, എഐയുടെ സഹായത്താൽ ഈ ശബ്ദം അതേപടി അനുകരിച്ചാണ് തട്ടിപ്പുകൾ നടത്തുന്നത്. അതിനാൽ ഇത്തരത്തിൽ അടിയന്തര സാഹചര്യം വിശദീകരിച്ച് പണം ആവശ്യപ്പെട്ട് കോളുകൾ എത്തിയാൽ ജാഗ്രതപാലിക്കണം എന്നാണ് മുന്നറിയിപ്പ്.

പണം കൈമാറും മുൻപ് വിളിക്കുന്നത് യഥാർഥ ആൾ തന്നെയാണ് എന്നും അയാർ പറഞ്ഞത് സത്യമാണ് എന്നും ഉറപ്പുവരുത്തണമെന്നും അധികൃതർ നിർദേശിക്കുന്നു. അത്യാവശ്യത്തിന് പണം കടം ചോദിച്ചാൽ ആരും നൽകാത്ത അവസ്ഥ ഭാവിയിൽ ഉണ്ടാകാൻ ഈ തട്ടിപ്പ് കാരണമായേക്കും. കാരണം, വിളിക്കുന്നത് യഥാർഥ ആൾ ആണ് എന്ന് ഉറപ്പിക്കാൻ വീഡിയോ കോൾ ചെയ്തിട്ടു പോലും കാര്യമുണ്ടാകില്ല.

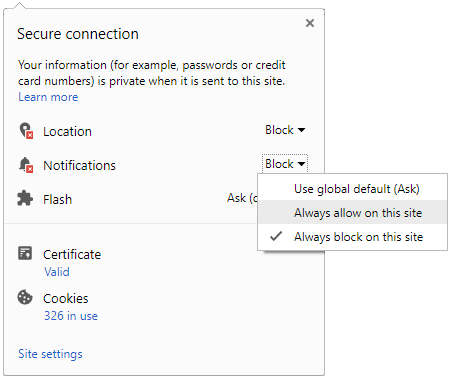

Click it and Unblock the Notifications

Click it and Unblock the Notifications

-1763362932432.svg)