മക്കളെ സ്നേഹിക്കുന്നവർ ജാഗ്രതൈ, തട്ടിപ്പുകാർക്ക് 'കയറിട്ട്' കൊടുക്കരുത്!

ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് സാങ്കേതികവിദ്യയുമായി ബന്ധപ്പെട്ട് നിരവധി പരീക്ഷണങ്ങൾ ഏറെ നാളായി നടക്കുന്നുണ്ട്. എന്നാൽ ഓപ്പൺഎഐ കമ്പനിയുടെ ചാറ്റ്ജിപിടി എഐ ചാറ്റ്ബോട്ട് പുറത്തുവന്ന് ലോകമാകെ തരംഗമായതിന് പിന്നാലെയാണ് എഐ ഗവേഷണങ്ങൾക്ക് ശക്തികൂടിയത്. ചാറ്റ്ജിപിടിക്ക് കിട്ടിയ ജനശ്രദ്ധയും മറ്റ് ടെക്നോളജി കമ്പനികളെയും എഐ പരീക്ഷണങ്ങൾ ശക്തമാക്കാൻ നിർബന്ധരാക്കി.

ഓപ്പൺഎഐയുടെ പ്രധാന സ്പോൺസർമാരായ മൈക്രോസോഫ്ട് തങ്ങളുടെ ബിങ്ങിലും എഐ ചാറ്റ്ബോട്ട് സംവിധാനം അവതരിപ്പിച്ച് ഗൂഗിൾ സേർച്ചിന് ശക്തമായ വെല്ലുവിളി ഉയർത്തി. അതിനെ നേരിടാൻ ബാർഡുമായി ഗൂഗിളും രംഗത്തെത്തി. ഇങ്ങനെ പല പ്രമുഖ കമ്പനികളും എഐയുഗത്തിൽ തങ്ങൾ പിന്തള്ളപ്പെടാതിരിക്കാൻ പുത്തൻ എഐ ടൂളുകൾക്കായുള്ള പരീക്ഷണങ്ങളുമായി മുന്നോട്ട് പോകുകയാണ്.

എന്തിനേറെ പറയുന്നു, എഐ അപകടകാരിയാണെന്നും പ്രത്യാഘാതം പഠിക്കുന്നതുവരെ ഗവേഷണങ്ങൾ നിർത്തിവയ്ക്കണമെന്നും ആവശ്യപ്പെട്ടുള്ള കത്തിൽ ഒപ്പുവച്ച ട്വിറ്റർ മേധാവി ഇലോൺ മസ്ക്പോലും X.AI എന്ന സ്വന്തം കമ്പനി ആരംഭിക്കാൻ ഒരുങ്ങുകയാണ് എന്നാണ് റിപ്പോർട്ട്. എഐയുടെ അനന്തസാധ്യതകളും കഴിവുകളും നാൾക്കുനാൾ പ്രശസ്തമായിക്കൊണ്ടിരിക്കുകയാണ്. എന്നാൽ നല്ലവശങ്ങൾക്കൊപ്പം എഐയുടെ കെട്ടവശങ്ങളും പുറത്തുവരുന്നുണ്ട്.

സാങ്കേതികവിദ്യയെ നിരവധി നല്ലകാര്യങ്ങൾക്കായി ഉപയോഗിക്കാം. എന്നാൽ ഇതേ സാങ്കേതികവിദ്യ ക്രിമിനലുകളുടെ കൈയിൽ എത്തുന്നത് സാധാരണക്കാരെയും ലോകത്തെത്തന്നെയും അപകടത്തിലാക്കുകയും ചെയ്യും. എഐ സാങ്കേതികവിദ്യ ഉപയോഗിക്കാവുന്ന മേഖലകളുടെ എണ്ണം അനന്തമാണ്. അങ്ങനെയുള്ള എഐ ഉപയോഗിച്ചുള്ള തട്ടിപ്പുകളും കൂടിവരികയാണ് എന്നതും ശ്രദ്ധിക്കേണ്ടതുണ്ട്. എഐ സൃഷ്ടിക്കാവുന്ന അപകടങ്ങളിലേക്ക് വിരൽ ചൂണ്ടുംവിധത്തിൽ ഇപ്പോൾ അമേരിക്കയിൽ നടന്ന ഒരു സംഭവം ലോകത്തെയാകെ ഞെട്ടിച്ചിരിക്കുകയാണ്.

അരിസോണയിൽ നിന്നുള്ള ജെന്നിഫർ ഡിസ്റ്റെഫാനോ എന്ന സ്ത്രീക്ക് ഒരു ദിവസം അജ്ഞാത നമ്പറിൽ നിന്ന് കോൾ എത്തി. കോൾ എടുത്ത അവർ കേട്ടത് അമ്മേ എന്നുള്ള മകളുടെ നിലവിളിയും കരച്ചിലുമായിരുന്നു. എന്താണ് സംഭവിച്ചത് എന്ന് ചോദിച്ചപ്പോൾ താൻ കുഴഞ്ഞുവീണു എന്നുള്ള മറുപടിയും കരച്ചിലുമാണ് ജെന്നിഫർ കേട്ടത്.

അപ്പോഴേക്കും മകളിൽനിന്ന് ഫോൺ പിടിച്ചുവാങ്ങി ഒരു പുരുഷൻ സംസാരിക്കാൻ തുടങ്ങി. നിങ്ങളുടെ മകൾ തങ്ങളുടെ കസ്റ്റഡിയിലുണ്ടെന്നും നിങ്ങൾ പോലീസിനെയോ മറ്റ് ആരെ വേണെമെങ്കലും വിളിച്ചോളൂ, എന്നാൽ, തങ്ങൾ തങ്ങളുടെ വഴിയേ മുന്നോട്ട് പോകുകയും മകൾക്ക് മയക്കുമരുന്ന് നൽകി അവളെ മെക്സിക്കോയിലേക്ക് അയയ്ക്കാൻ പോകുന്നു എന്നും അയാൾ പറഞ്ഞു.

അയാൾ സംസാരിച്ചുകൊണ്ടിരിക്കുന്ന ഈ സമയത്ത് മകൾ കരയുന്നതും സഹായത്തിനായി അഭ്യർഥിക്കുന്നതും പശ്ചാത്തലത്തിൽ കേൾക്കുന്നുണ്ടായിരുന്നു. മകളെ വിട്ടുനൽകണമെങ്കിൽ ഒരു മില്യൺ ഡോളർ നൽകണം എന്നായിരുന്നു ആവശ്യം. എന്നാൽ അത്രയും പണം നൽകാൻ തന്റെ കൈയിലില്ല എന്ന് അറിയിച്ചപ്പോൾ 50,000 യുഎസ് ഡോളർ നൽകിയാൻ മതി എന്നായി അയാൾ.

ജെന്നിഫറിന്റെ പതിനഞ്ചുവയസുള്ള മകൾ സ്കീയിങ്ങിനായി പോയിരിക്കുകയായിരുന്നു. അവളെ തട്ടിക്കൊണ്ടുപോയെന്നും മോചന ദ്രവ്യം വേണമന്നും ആവശ്യപ്പെട്ടുകൊണ്ടുള്ള കോൾ ആണ് ജെന്നിഫറിനെ തേടി എത്തിയത്. അക്രമികൾ വിളിക്കുമ്പോൾ ജെന്നിഫർ മറ്റൊരു മകളുടെ ഡാൻസ് സ്റ്റുഡിയോയിലായിരുന്നു. മറ്റു കുട്ടികളുടെ നിരവധി മാതാപിതാക്കളും ജെന്നിഫറിന് ഒപ്പമുണ്ടായിരുന്നു. സംഭവങ്ങൾ കേട്ടുകൊണ്ടിരുന്ന അവർ ജെന്നിഫറിന്റെ സഹായത്തിനെത്തി.

രക്ഷിതാക്കളിൽ ഒരാൾ 911 എന്ന നമ്പറിലേക്ക് വിളിച്ച് കാര്യം പറഞ്ഞു, മറ്റൊരാൾ ജെന്നിഫറിന്റെ ഭർത്താവിനെ വിവരം അറിയിച്ചു. തുടർന്ന് മിനിറ്റുകൾക്കകും അവരുടെ മകൾ സുരക്ഷിതയാണ് എന്നും സ്കീയിങ് നടക്കുന്നിടത്ത് ഉണ്ട് എന്നും വിവരമമെത്തി. ഇതോടെയാണ് വ്യാജ ശബ്ദ്ം ഉപയോഗിച്ച് പണം തട്ടാനുള്ള തട്ടിപ്പ് സംഘത്തിന്റെ നീക്കം പൊളിഞ്ഞത്.

ഭാഗ്യം കൊണ്ടും ചുറ്റും നിരവധി മാതാപിതാക്കൾ സഹായിക്കാൻ ഉണ്ടായിരുന്നതുകൊണ്ടും തനിക്ക് അബദ്ധം പറ്റിയില്ല. എന്നാൽ എല്ലാവരുടെയും കാര്യം അങ്ങനെ ആയിരിക്കില്ല. ഇത്തരം തട്ടിപ്പുകളെപ്പറ്റി എല്ലാവരും ജാഗ്രത പാലിക്കണമെന്നും ഇത്തരം കബളിപ്പിക്കലുകളിൽ വീഴാതിരിക്കാൻ നേരത്തെ തന്നെ കുടുംബത്തിനുള്ളിൽത്തന്നെ എന്തെങ്കിലും രഹസ്യകോഡുകൾ നിശ്ചയിച്ച് വയ്ക്കണം എന്നും അവർ ആവശ്യപ്പെടുന്നു.

കോൾ എത്തിയപ്പോൾ മറുവശത്ത് ആരാണ് എന്ന് ചോദിക്കേണ്ട ആവശ്യംപോലും ഉണ്ടായിരുന്നില്ല. അത്രയ്ക്ക് വ്യക്തമായി അത് തന്റെ മകളുടെ ശബ്ദം ആണ് എന്ന് തിരിച്ചറിയാൻ കഴിഞ്ഞിരുന്നു എന്നാണ് ജെന്നിഫർ മൊഴി നൽകിയിരിക്കുന്നത്. അവൾ എങ്ങനെ കരയുമോ അതുപോലെ തന്നെയായിരുന്നു കരച്ചിൽ. അത് മകളല്ല എന്ന് തനിക്ക് ഒരു സെക്കൻഡ് പോലും സംശയം തോന്നിയില്ലെന്നും അവർ പറയുന്നു.

എഐ അടിസ്ഥാനമാക്കിയുള്ള വോയ്സ് ക്ലോണിങ് സാങ്കേതികവിദ്യയാണ് തട്ടിപ്പുകാർ ഇവിടെ ഉപയോഗപ്പെടുത്തിയത് എന്നാണ് എഫ്ബിഐയുടെ ഫീനിക്സ് ഓഫീസിന്റെ ചുമതലയുള്ള അസിസ്റ്റന്റ് സ്പെഷ്യൽ ഏജന്റ് പറയുന്നത്. തട്ടിപ്പുകാർ സാമൂഹിക മാധ്യമങ്ങളിലൂടെയാണ് തങ്ങളുടെ ഇരകളെ കണ്ടെത്തുന്നത് എന്നും അദ്ദേഹം വ്യക്തമാക്കുന്നു. ഇനിയും ഇതേരീതിയിൽ കബളിപ്പിക്കൽ ശ്രമങ്ങൾ നടക്കാമെന്നും ജാഗ്രതപാലിക്കണം എന്നും അധികൃതർ നിർദേശിച്ചു.

ഏതാനും നാൾ മുമ്പ് എഐ ഉപയോഗിച്ച് മനുഷ്യന്റെ ശബ്ദം അനുകരിക്കാൻ സാധിക്കുമെന്നും വികാരങ്ങൾ പോലും കൃത്യമായി അനുകരിക്കാൻ കഴിയുമെന്നും വാർത്ത വന്നിരുന്നു. എഐയുടെ മറ്റൊരു നേട്ടം എന്നാണ് അന്ന് അത് വിലയിരുത്തപ്പെട്ടത്. എന്നാൽ നേട്ടത്തിനൊപ്പം അതിലെ അപകടത്തെപ്പറ്റിയും അന്നുതന്നെ ചിലർ ചൂണ്ടിക്കാട്ടിയിരുന്നു.

വെറും മൂന്ന് സെക്കൻഡ് കേട്ടാൽ ആരുടെയും ശബ്ദം അനുകരിക്കാൻ ഈ എഐ ടൂളിന് കഴിയും. ശബ്ദം നേരിട്ട് കേൾക്കണമെന്നില്ല. റെക്കോഡ് ചെയ്തത് കേട്ടാലും മതി. മൂന്ന് മിനിറ്റിൽ കൂടുതൽ നേരമുള്ള സാമ്പിളാണ് നൽകുന്നത് എങ്കിൽ കൂടുതൽ കൃത്യതയോടെ വികാരങ്ങൾ പ്രതിഫലിപ്പിക്കാൻ കഴിയും. നിലവിൽ ഇത്തരം പരീക്ഷണങ്ങൾ പലരും കൂടുതൽ ശക്തമായി വരുന്നതേയുള്ളൂ.

എങ്കിലും ഇപ്പോൾത്തന്നെ തട്ടിപ്പുകാർ അത് ഉപയോഗപ്പെടുത്താൻ തുടങ്ങിക്കഴിഞ്ഞു. ഇനിയും ആളുകളുടെ ശബ്ദം അനുകരിച്ച് വിവിധ മാർഗങ്ങളിൽ ആളുകളെ കബളിപ്പിച്ച് പണം തട്ടാനുള്ള ശ്രമങ്ങൾ തുടരുകതന്നെ ചെയ്യും ജാഗ്രത പുലർത്തുക എന്നതാണ് പോംവഴി. മക്കളുടെ ചിത്രങ്ങളും വീഡിയോകളും മറ്റും സാമൂഹികമാധ്യമങ്ങളിൽ പങ്കുവയ്ക്കാതിരിക്കുക എന്നതും ഏറെ പ്രധാനമാണ്.

കാരണം സാമൂഹികമാധ്യമങ്ങളിൽനിന്ന് ലഭിക്കുന്ന വിവരങ്ങളുടെ സഹായത്താലാണ് തട്ടിപ്പുകാർ നിങ്ങൾക്കുള്ള കുരുക്ക് തയാറാക്കുന്നത്. ആളുകൾ പങ്കുവയ്ക്കുന്ന മക്കളുടെ വീഡിയോയിൽനിന്ന് അവരുടെ ശബ്ദം അനുകരിക്കാനുള്ള സാമ്പിൾ ഉൾപ്പെടെ ലഭ്യമാകും. ഡീപ് ലേണിംഗ് ടെക്നോളജിക്ക് നിലവിൽ മേൽനോട്ടം വളരെ കുറവാണ്. അതുമൊരു പോരായ്മയാണ്. ഇത്തരം സാങ്കേതികവിദ്യകൾ ആർക്കും എളുപ്പത്തിൽ ഉപയോഗിക്കാൻ കഴിയുന്ന അവസ്ഥ മാറണമെന്നും ആവശ്യമുയരുന്നുണ്ട്.

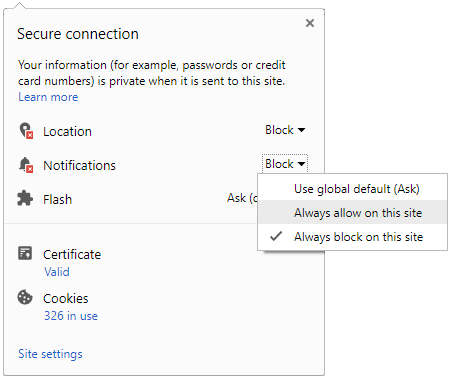

Click it and Unblock the Notifications

Click it and Unblock the Notifications

-1763362932432.svg)